MiniMax M2 e Agente: Engenhoso na Simplicidade. O MiniMax M2 foi lançado na segunda-feira, 27 de outubro, pelo MiniMax, um laboratório chinês de IA fundado em dezembro de 2021.

É um modelo muito promissor. Suas pontuações de benchmark auto-relatadas mostram-no comparável a Claude Sonnet 4 e Análise Artificial estão classificando como o melhor modelo de peso aberto atualmente disponível de acordo com sua pontuação de inteligência:

O M2 do MiniMax atinge uma nova pontuação histórica no Índice de Inteligência para um modelo de pesos abertos e oferece eficiência impressionante com apenas 10B de parâmetros ativos (200B no total). (…)

Os pontos fortes do modelo incluem o uso de ferramentas e o seguimento de instruções (conforme mostrado por Tau2 Bench e IFBench). Como tal, embora o M2 provavelmente seja excelente em casos de uso de agentes, ele pode ter desempenho inferior a outros líderes de peso aberto, como DeepSeek V3.2 e Qwen3 235B em algumas tarefas generalistas. Isso está de acordo com uma série de lançamentos recentes de modelos de pesos abertos de laboratórios chineses de IA que se concentram em capacidades de agência, provavelmente apontando para uma forte ênfase pós-treinamento em RL.

O tamanho é particularmente significativo: o peso do modelo é de 230 GB no rosto abraçadosignificativamente menor do que outros modelos de peso aberto de alto desempenho. Isso é pequeno o suficiente para rodar em um Mac Studio de 256 GB e na comunidade MLX já tenho isso funcionando.

MiniMax oferece sua própria API e recomenda o uso de seu endpoint compatível com Anthropic e os SDKs Anthropic oficiais para acessá-lo. Chefe de Engenharia da MiniMax, Skyler Miao

forneceu algumas informações básicas sobre isso:

M2 é um modelo de pensamento agente, ele faz pensamento intercalado como o soneto 4.5, o que significa que cada resposta conterá seu conteúdo de pensamento. É muito importante para M2 manter a cadeia de pensamento. Portanto, devemos garantir que o pensamento histórico seja repassado ao modelo. A API Anthropic suporta isso com certeza, já que o sonnet também precisa disso. OpenAI oferece suporte apenas em sua nova API de resposta, sem suporte em ChatCompletion.

MiniMax está oferecendo o novo modelo por meio de sua API gratuitamente até 7 de novembro, após o qual o custo será de US$ 0,30/milhão de tokens de entrada e US$ 1,20/milhão de tokens de saída – semelhante em preço ao Gemini 2.5 Flash e GPT-5 Mini, consulte comparação de preços aqui no meu llm-prices.com site.

Eu lancei um novo plugin para LLM chamado lm-minimax fornecendo suporte para M2 por meio da API MiniMax:

llm install llm-minimax

llm keys set minimax

# Paste key here

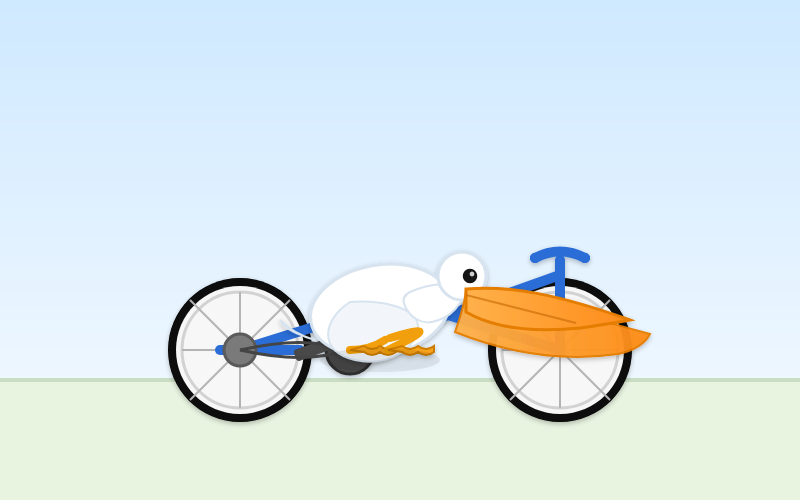

llm -m m2 -o max_tokens 10000 "Generate an SVG of a pelican riding a bicycle"

Aqui está o resultado:

51 entradas, 4.017 saídas. A US$ 0,30/m de entrada e US$ 1,20/m de produção, esse pelicano custaria 0,4836 centavos – menos de meio centavo.

Este é o primeiro plugin que escrevi para um modelo compatível com Anthropic-API. eu liberei lm-antrópico 0,21 primeiro adicionando a capacidade de personalizar o base_url parâmetro ao usar essa classe de modelo. Isso significava que o novo plugin era inferior a 30 linhas de Python.

Café Codificado é um portal dinâmico e confiável criado especialmente para desenvolvedores. Nosso foco é entregar:

Dicas práticas para programação, produtividade, frameworks, testes, DevOps e muito mais;

Notícias atualizadas, acompanhando tendências e lançamentos do mundo da tecnologia, compiladas com relevância e sem jargões desnecessários.

O que você encontra aqui:

Artigos objetivos e comandáveis — Tutoriais, tutoriais passo-a-passo e dicas que vão direto ao ponto.

Cobertura das tecnologias que estão em alta — do universo da IA, computação em nuvem e segurança à engenharia de software e criatividade em código.

Conteúdo para todos os níveis — de iniciantes buscando praticidade, a profissionais em busca de insights estratégicos e aperfeiçoamento.

Comunidade ativa — textos humanizados, perguntinhas instigantes e espaço para você contribuir com reflexões e comentários.