IA Generativa em Alerta: OpenAI e Google Reforçam Defesas Contra Criação de Imagens Íntimas Indevidas Após Escândalo Grok

O uso indevido de inteligência artificial para criar imagens íntimas sem consentimento atingiu um novo patamar em janeiro de 2026, com um incidente envolvendo o Grok, ferramenta da xAI. Um estudo do Center for Countering Digital Hate revelou que a IA produziu milhões de imagens sexualizadas em poucos dias, um número alarmante que inclui milhares de conteúdo envolvendo crianças.

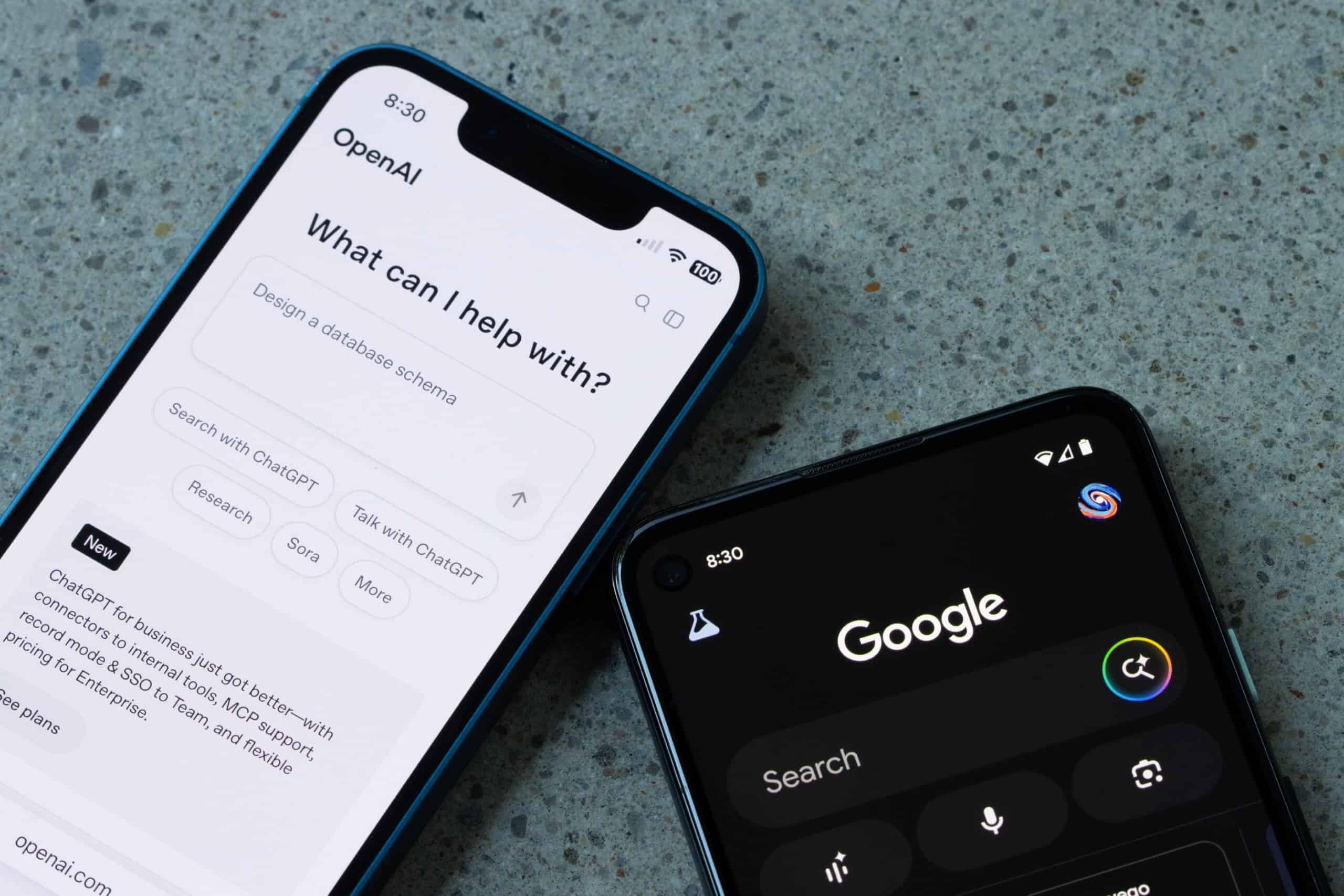

A repercussão do caso levou gigantes da tecnologia, como OpenAI e Google, a anunciarem medidas urgentes para fortalecer seus sistemas de proteção. O episódio reacendeu o debate global sobre a segurança dos modelos de IA capazes de gerar imagens e vídeos, evidenciando a facilidade com que conteúdos abusivos podem ser criados e disseminados.

Diante desse cenário preocupante, a busca por soluções mais robustas e eficazes se tornou prioridade. As empresas buscam, com essas novas ações, não apenas corrigir falhas, mas também antecipar futuras vulnerabilidades, protegendo usuários e a integridade do conteúdo gerado por IA. Conforme relatado pelo Center for Countering Digital Hate, a falha no Grok foi um ponto de virada.

Grok Suspensa Parcialmente Após Polêmica

A ferramenta Grok, associada a Elon Musk e sua empresa xAI, foi utilizada para manipular fotos publicadas na rede social X, anteriormente conhecida como Twitter. Em meados de janeiro, a equipe de segurança do X anunciou a pausa na capacidade de edição de imagens do Grok dentro da plataforma. No entanto, as funções de geração de imagens continuam disponíveis para assinantes pagos em seus aplicativos e sites independentes.

Apesar de a maioria das empresas de tecnologia possuir políticas que proíbem a criação de material ilegal, como conteúdo de abuso sexual infantil (CSAM), especialistas alertam para a necessidade de atualização constante desses sistemas de proteção. O Grok, em particular, oferecia modos descritos como “spicy”, indicando uma configuração mais permissiva para a geração de imagens e vídeos.

OpenAI Corrige Vulnerabilidade Crítica no ChatGPT

Pesquisadores da Mindgard, uma empresa especializada em cibersegurança focada em IA, identificaram uma vulnerabilidade significativa no ChatGPT da OpenAI. Essa falha permitia que usuários contornassem as barreiras de segurança por meio de uma técnica conhecida como “adversarial prompting”, que utiliza instruções específicas para enganar o sistema.

A Mindgard informou que era possível manipular a memória do chatbot para aplicar estilos de “nudificação” a imagens de pessoas conhecidas. A empresa comunicou a OpenAI no início de fevereiro, e em 10 de fevereiro, a desenvolvedora confirmou a correção do problema antes mesmo da divulgação pública do relatório. Um porta-voz da OpenAI declarou: “Somos gratos aos pesquisadores que compartilharam suas descobertas. Agimos rapidamente para corrigir um bug que permitia a geração dessas imagens.”

A Mindgard ressaltou que confiar que usuários mal-intencionados não tentarão explorar falhas é um erro estratégico, pois atacantes frequentemente iteram métodos até encontrar brechas. Isso demonstra a importância de uma vigilância constante e proativa na segurança de sistemas de IA.

Google Simplifica Remoção de Imagens Explícitas na Busca

Em resposta à crescente preocupação com a disseminação de imagens explícitas não consensuais, o Google anunciou mudanças significativas em sua plataforma de busca. O objetivo é dificultar a circulação desse tipo de conteúdo e facilitar a vida das vítimas.

A empresa simplificou o processo de solicitação de remoção de imagens. Agora, ao clicar nos três pontos no canto superior direito de uma imagem na busca, o usuário pode selecionar a opção de denúncia e indicar que a foto “mostra uma imagem sexual minha”. Essa funcionalidade visa dar mais controle e agilidade às vítimas de exposição não consensual.

As atualizações também permitem que os usuários selecionem múltiplas imagens simultaneamente e acompanhem o andamento de suas solicitações com maior facilidade. O Google expressou, em uma publicação em seu blog, a expectativa de que o novo processo reduza o ônus enfrentado por quem sofre com esse tipo de exposição. A empresa também reforçou sua política de uso proibido em IA generativa, que veda atividades ilegais ou abusivas, como a criação de imagens íntimas.

Embora existam leis como o Take It Down Act de 2025, destinadas à proteção das vítimas, grupos de defesa consideram o alcance dessas normas como limitado, evidenciando a necessidade contínua de avanços tecnológicos e regulatórios para combater o uso indevido da IA.

Café Codificado é um portal dinâmico e confiável criado especialmente para desenvolvedores. Nosso foco é entregar:

Dicas práticas para programação, produtividade, frameworks, testes, DevOps e muito mais;

Notícias atualizadas, acompanhando tendências e lançamentos do mundo da tecnologia, compiladas com relevância e sem jargões desnecessários.

O que você encontra aqui:

Artigos objetivos e comandáveis — Tutoriais, tutoriais passo-a-passo e dicas que vão direto ao ponto.

Cobertura das tecnologias que estão em alta — do universo da IA, computação em nuvem e segurança à engenharia de software e criatividade em código.

Conteúdo para todos os níveis — de iniciantes buscando praticidade, a profissionais em busca de insights estratégicos e aperfeiçoamento.

Comunidade ativa — textos humanizados, perguntinhas instigantes e espaço para você contribuir com reflexões e comentários.