O mundo dos dados está em constante evolução, e com ele surgem novas ferramentas que prometem otimizar o processamento e a troca de informações. Um dos softwares que tem se destacado nesse cenário é o Apache Kafka, uma plataforma de streaming amplamente utilizada para gerenciar fluxos de dados em tempo real. Compreender como o Kafka pode ser integrado aos seus processos pode ser a chave para transformar não apenas a forma como você lida com dados, mas também a eficiência operacional de sua equipe. Neste artigo, vamos explorar o que é o Apache Kafka, como ele funciona, suas aplicações práticas, e as melhores práticas para implementá-lo em seus projetos.

Desmistificando o Kafka: Como Este Software Pode Transformar Seu Processo de Dados

Ao longo deste conteúdo, você aprenderá sobre a arquitetura do Kafka, suas principais funcionalidades, e como ele se compara a outras ferramentas de gerenciamento de dados, como Node.js e Django. Também discutiremos exemplos práticos de uso, vantagens competitivas, e as tendências futuras que moldarão o processamento de dados. Nossa intenção é não apenas desmistificar o Kafka, mas também ajudar você a compreender como essa poderosa ferramenta pode transformar a sua abordagem em projetos que envolvem grandes volumes de dados.

Prepare-se para uma imersão no mundo do Kafka e descubra como essa tecnologia pode agregar valor ao seu trabalho e à sua empresa. Vamos começar!

O que é o Apache Kafka?

Apache Kafka é uma plataforma de streaming de eventos que permite a criação de aplicações em tempo real que processam, armazenam e transmitem dados em alta velocidade. Desenvolvido originalmente pelo LinkedIn e se tornando um projeto da Apache Software Foundation, o Kafka é desenvolvido para manipular grandes quantidades de dados de forma confiável e escalável. Este software se baseia em uma arquitetura distribuída, que permite a sua utilização em diversos cenários, desde sistemas de monitoramento até aplicações de big data.

Uma das características mais marcantes do Kafka é sua capacidade de atuar como um sistema de mensageria altamente resiliente. Ele é projetado para manter a ordem dos eventos, o que é crucial em muitas aplicações, como transações financeiras e sistemas de monitoramento. Ao lado disso, o Kafka suporta a persistência de dados, o que significa que as informações podem ser recuperadas mesmo após a falha de um sistema.

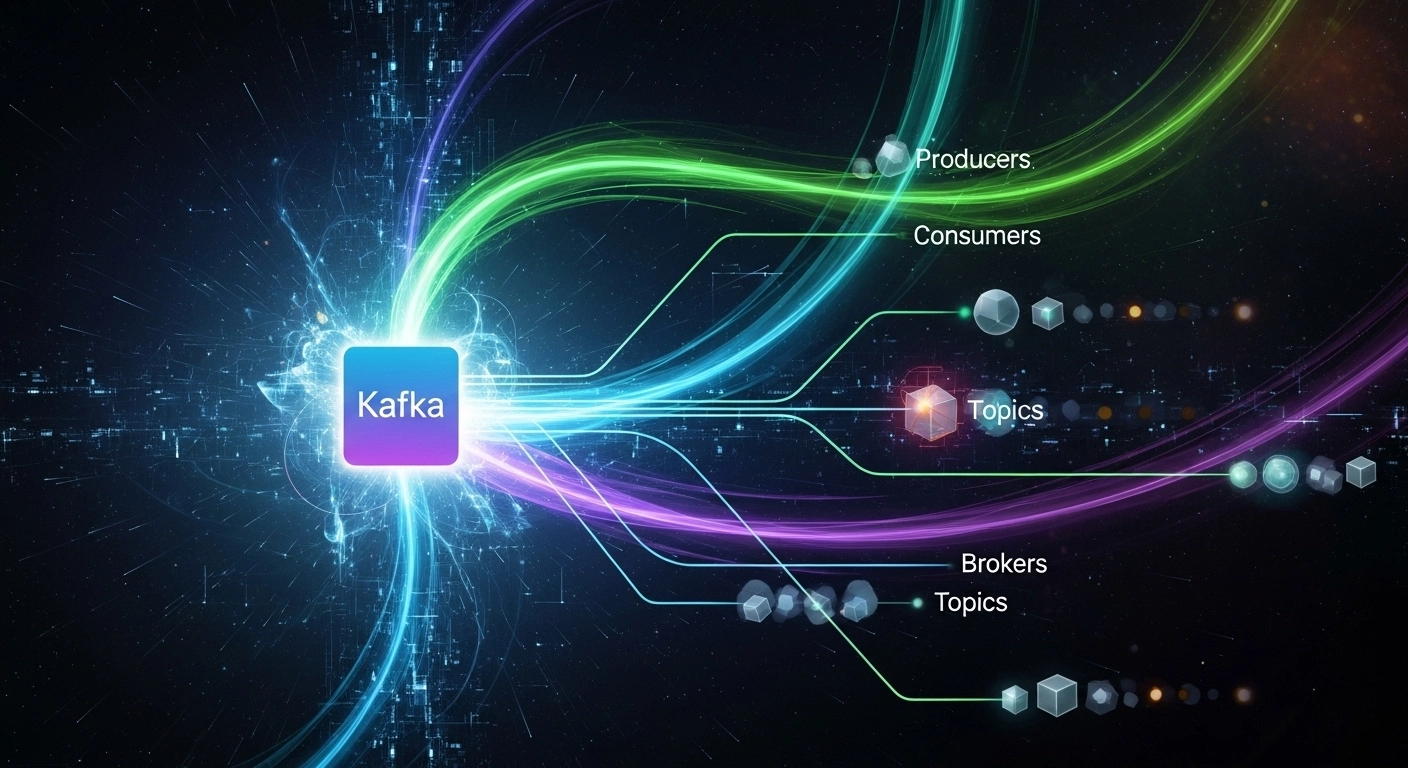

A arquitetura do Kafka é composta por três elementos principais: produtores, consumidores e brokers. Os produtores são responsáveis por escrever dados no Kafka, enquanto os consumidores leem esses dados. Os brokers, por sua vez, são os servidores que armazenam e gerenciam as mensagens. O Kafka se destaca também por sua capacidade de escalar horizontalmente, permitindo que novos brokers sejam adicionados ao cluster conforme a demanda cresce.

Por que usar o Apache Kafka?

Adotar o Apache Kafka pode oferecer uma série de benefícios significativos, especialmente quando se trata de gerenciar fluxos de dados em tempo real. Um dos pontos mais relevantes é a eficiência em processamento de dados. O Kafka é capaz de processar milhões de eventos por segundo, o que torna o software imprescindível para empresas que lidam com grandes volumes de dados. Além disso, ele permite a integração com outras tecnologias populares, como Node.js e Django, o que o torna uma escolha versátil para uma variedade de projetos.

Outro benefício importante é a resiliência. O Kafka foi projetado para ser altamente disponível e tolerante a falhas. Isso significa que, mesmo em situações em que um ou mais brokers falham, o sistema continua operando sem perda de dados. A última característica a ser destacada é a sua flexibilidade. O Kafka pode ser utilizado em diversos cenários: desde a coleta de logs e monitoramento de sistemas até o processamento de dados em tempo real e análise de eventos.

Arquitetura do Kafka

A arquitetura do Apache Kafka é uma de suas características mais robustas e inovadoras. Compreender como cada componente funciona pode ajudar você a otimizar sua utilização dessa ferramenta. A arquitetura é composta por:

- Producers: São as aplicações que escrevem dados para o Kafka. Eles podem enviar mensagens para diferentes tópicos, onde os dados são organizados.

- Topics: Os tópicos são as categorias em que as mensagens são organizadas. Cada tópico pode ter múltiplas partições, permitindo que dados sejam distribuídos entre diferentes brokers.

- Brokers: Servidores Kafka que armazenam dados e gerenciam a comunicação entre produtores e consumidores.

- Consumers: Aplicações que lêem dados dos tópicos do Kafka. Eles podem ser parte de grupos de consumidores, onde cada mensagem é lida apenas uma vez.

O Kafka utiliza um mecanismo de log commit para garantir a durabilidade dos dados. Ao contrário de outras ferramentas que usam bancos de dados tradicionais, o Kafka mantém um registro sequencial de todas as mensagens, permitindo que os dados sejam rastreados e recuperados com facilidade. Isso significa que, mesmo após a leitura, as mensagens permanecem disponíveis para novos consumidores, possibilitando uma análise histórica dos dados.

Integração com Outras Tecnologias

Uma das grandes vantagens do Apache Kafka é a sua capacidade de se integrar com outras tecnologias e frameworks populares. Essa característica torna o Kafka uma escolha atrativa para desenvolvedores que utilizam linguagens como JavaScript, Python e frameworks como Django e Node.js. Integrar o Kafka com esses ambientes pode potencializar as funcionalidades de suas aplicações, especialmente quando se trata de processamento de dados em tempo real.

Por exemplo, usando o Kafka com Node.js, é possível criar aplicações que consomem dados instantaneamente e reagem a eventos em tempo real. Assim, você pode criar dashboards dinâmicos que refletem mudanças em dados assim que elas acontecem. Da mesma forma, ao integrar com Django, é possível construir APIs robustas que se tornam mais eficientes na manipulação de informações provenientes do Kafka.

Essas integrações não apenas aumentam a eficiência operacional, mas também trazem robustez às aplicações, permitindo que os desenvolvedores se concentrem mais na construção de funcionalidades do que na gestão de dados. Além disso, existem diversas bibliotecas e ferramentas de suporte que tornam essa integração ainda mais simples, como o KafkaJS para JavaScript e o Confluent Kafka para Python.

Checklist para Implementação do Apache Kafka

Antes de implementar o Apache Kafka em seu projeto, considere os seguintes pontos que podem servir como um guia para sua adoção:

- Definir claramente os objetivos do projeto: O que você espera alcançar com o Kafka?

- Mapear os fluxos de dados: Quais informações serão produzidas e consumidas?

- Escolher a arquitetura do cluster: Quantos brokers serão necessários?

- Planejar a segurança: Como proteger seus dados e gerenciar acessos?

- Realizar testes: Como você irá avaliar a performance e a resiliência do sistema?

Aplicações Práticas do Kafka

A utilização do Apache Kafka se estende a várias indústrias e setores. Várias empresas têm adotado essa tecnologia para resolver problemas específicos relacionados ao gerenciamento de dados. Veja alguns exemplos de aplicações práticas:

Streaming de Dados em Tempo Real

Muitas organizações utilizam o Kafka para processar dados em tempo real, permitindo a análise instantânea de informações. Um exemplo disso pode ser encontrado no setor financeiro, onde o Kafka é utilizado para monitorar transações em tempo real, ajudando a detectar fraudes e a gerar relatórios imediatos.

Log Aggregation

Outra aplicação comum do Kafka é a agregação de logs. Ao invés de depender de logs que podem ser dispersos em diferentes servidores, o Kafka permite centralizar essas informações. Isso facilita a análise posterior e a geração de relatórios sobre o desempenho dos sistemas.

Integração de Microserviços

Com a popularização da arquitetura de microserviços, o Kafka se tornou uma escolha popular para comunicação entre serviços. Ele permite que diferentes microserviços se comuniquem de forma assíncrona, reduzindo a complexidade e aumentando a resiliência do sistema.

Comparação com Outras Ferramentas

O Apache Kafka não é a única opção disponível para gerenciamento de dados em tempo real. A seguir, apresentamos uma comparação entre Kafka e outras duas ferramentas populares: RabbitMQ e AWS Kinesis.

| Característica | Apache Kafka | RabbitMQ | AWS Kinesis |

|---|---|---|---|

| Modelo de Mensagens | Publicação/Sujeição | Mensageria baseada em filas | Streaming de dados |

| Persistência de Dados | Persistente | Persistente | Persistente |

| Interface de API | Várias linguagens | Principalmente Erlang | Serviços da AWS |

| Desempenho | Alto (milhões de eventos por segundo) | Moderado | Alto |

| Complexidade de Setup | Alta | Baixa | Média |

Como podemos ver na tabela acima, o Apache Kafka se destaca por seu alto desempenho e capacidade de lidar com grandes volumes de eventos, tornando-o uma escolha sólida para aplicações que exigem processamento em tempo real. Enquanto RabbitMQ pode ser mais fácil de implementar, seu modelo de mensageria não é tão eficiente em cenários de alta demanda quanto o Kafka. Por outro lado, o AWS Kinesis oferece uma solução baseada em nuvem que pode ser ideal para quem já está integrado ao ecossistema AWS.

Tendências e Avanços Futuros no Processamento de Dados

À medida que continuamos a avançar na era digital, as tecnologias de processamento de dados estão evoluindo rapidamente. O Kafka está na vanguarda dessas mudanças, e algumas tendências significativas incluem:

- Processamento de Dados em Tempo Real: Com o aumento do uso de dispositivos IoT e a crescente demanda por dados instantâneos, espera-se que o processamento em tempo real se torne uma necessidade cada vez mais comum.

- Integração com Inteligência Artificial: O Kafka está se integrando a soluções de IA para permitir análises preditivas, automatizando decisões com base em dados.

- Adoção de Arquiteturas Serverless: Com a crescente popularidade de funções serverless, espera-se que o Kafka se torne uma parte essencial de arquiteturas que priorizam agilidade e escalabilidade.

Essas tendências não apenas moldarão como desenvolvemos aplicações, mas também impactarão a forma como gerenciamos e percebemos os dados no futuro.

Perguntas Frequentes (FAQs)

1. O que é Apache Kafka?

Apache Kafka é uma plataforma de streaming de eventos que permite o processamento, armazenamento e transmissão de dados em tempo real.

2. Quais são as principais características do Kafka?

Kafka é conhecido por sua alta capacidade de processamento, resiliência e arquitetura distribuída, que permite escalar facilmente.

3. Onde posso utilizar o Apache Kafka?

Kafka pode ser utilizado para monitoramento de sistemas, análise de dados em tempo real, integração de microserviços e muito mais.

4. Como o Kafka se compara a outras ferramentas de mensageria?

Kafka se destaca em performance e durabilidade, especialmente em situações que envolvem grandes volumes de eventos, em comparação com ferramentas como RabbitMQ e AWS Kinesis.

5. O Kafka é adequado para pequenas aplicações?

Embora seja possível usar o Kafka para pequenas aplicações, sua complexidade pode ser excessiva para cenários simples. Alternativas mais simples podem ser mais apropriadas.

6. É necessário conhecimento técnico para usar o Kafka?

Sim, é recomendável ter uma boa compreensão dos conceitos de streaming de dados e arquitetura distribuída para implementar o Kafka de maneira eficaz.

7. O Kafka é gratuito?

Sim, o Apache Kafka é um projeto open-source e pode ser utilizado gratuitamente. No entanto, custos podem surgir com infraestrutura e suporte técnico.

Conclusão

Ao longo deste artigo, exploramos as funcionalidades do Apache Kafka, sua arquitetura e as aplicações práticas que ele oferece. O Kafka se destaca como uma solução poderosa para otimizar o processamento de dados em tempo real e integrar diversas ferramentas, seja em contextos de microserviços, análise de eventos ou agregação de logs.

Incorporar o Kafka em seus projetos pode revolucionar a forma como você lida com dados, trazendo eficiência, segurança e escalabilidade. Ao utilizar tecnologias como Node.js e Django em conjunto com o Kafka, você pode ampliar ainda mais suas capacidades, criando aplicações completas e dinâmicas que respondem a eventos em tempo real.

Não deixe de acompanhar as tendências futuras que se desenham no horizonte do processamento de dados. Ao entender e aproveitar essas tecnologias, você estará na vanguarda da inovação e preparado para enfrentar os desafios do futuro. Invista em conhecimento, explore o Apache Kafka e descubra novas maneiras de transformar sua abordagem em Projetos de Dados!

Café Codificado é um portal dinâmico e confiável criado especialmente para desenvolvedores. Nosso foco é entregar:

Dicas práticas para programação, produtividade, frameworks, testes, DevOps e muito mais;

Notícias atualizadas, acompanhando tendências e lançamentos do mundo da tecnologia, compiladas com relevância e sem jargões desnecessários.

O que você encontra aqui:

Artigos objetivos e comandáveis — Tutoriais, tutoriais passo-a-passo e dicas que vão direto ao ponto.

Cobertura das tecnologias que estão em alta — do universo da IA, computação em nuvem e segurança à engenharia de software e criatividade em código.

Conteúdo para todos os níveis — de iniciantes buscando praticidade, a profissionais em busca de insights estratégicos e aperfeiçoamento.

Comunidade ativa — textos humanizados, perguntinhas instigantes e espaço para você contribuir com reflexões e comentários.